robots.txt para IA – Como Controlar Crawlers de Inteligência Artificial no Teu Site

O ficheiro robots.txt existe há décadas. Foi criado para dizer ao Googlebot e a outros crawlers de motores de busca o que podem ou não indexar no teu site.

Durante anos, era um ficheiro simples com uma função simples.

Essa simplicidade acabou.

Hoje, o teu robots.txt é visitado por crawlers de dezenas de sistemas de inteligência artificial – o GPTBot da OpenAI, o ClaudeBot da Anthropic, o Google-Extended do Google, o PerplexityBot, o Meta-ExternalAgent e muitos outros.

Cada um deles usa o conteúdo do teu site para treinar modelos ou para gerar respostas em tempo real.

E a maioria dos sites portugueses não tem nenhuma instrução para nenhum deles.

Neste artigo explico como funciona o robots.txt para crawlers de IA, quais os user-agents mais relevantes, como bloquear ou permitir seletivamente, e como esta decisão se encaixa na tua estratégia de otimização para inteligência artificial.

O que é o robots.txt e como funciona

O robots.txt é um ficheiro de texto simples colocado na raiz do teu site (por exemplo, heldermesquita.pt/robots.txt) que segue o Robots Exclusion Protocol – uma convenção criada em 1994 que define como os crawlers devem comportar-se quando visitam um site.

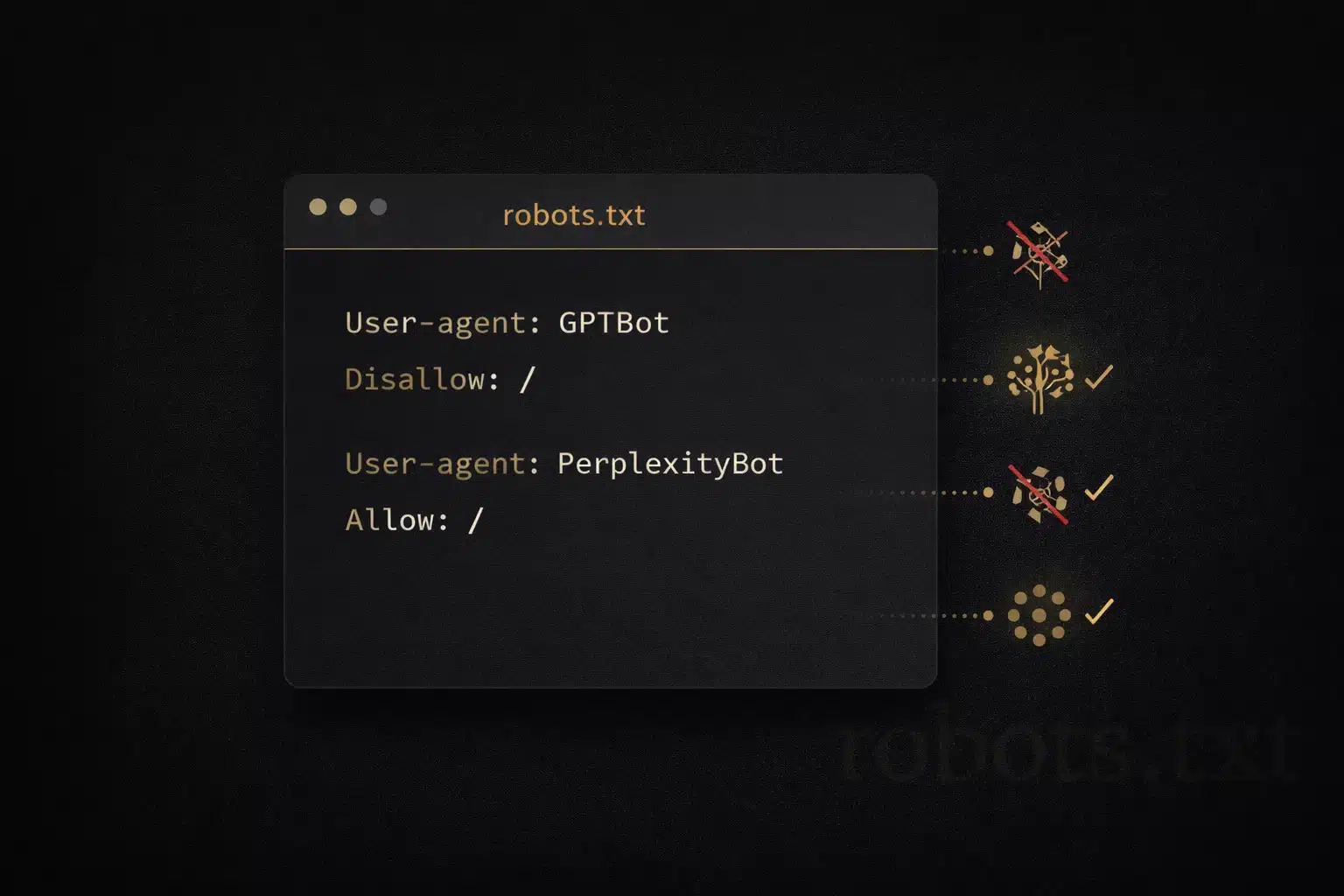

A estrutura é simples: identificas um agente (User-agent) e defines o que está permitido (Allow) ou proibido (Disallow).

O ponto crítico que muita gente esquece: o robots.txt não é um mecanismo de segurança.

É uma instrução de cortesia – um crawler bem-comportado respeita-o, mas um crawler malicioso ignora-o completamente.

Os crawlers dos grandes sistemas de IA (OpenAI, Anthropic, Google, Meta) respeitam o robots.txt. Crawlers de scraping genérico podem não respeitar.

Porquê o robots.txt para IA é diferente do robots.txt para SEO

Quando configuras o robots.txt para o Google, o objetivo é controlar o que é indexado nos resultados de pesquisa e evitar conteúdo duplicado, proteger áreas privadas, gerir o crawl budget.

Quando configuras o robots.txt para crawlers de IA, o contexto é completamente diferente.

Estás a decidir se o teu conteúdo pode ser usado para:

- Treinar modelos de linguagem – o crawler visita o site, extrai texto, e esse texto entra no dataset de treino de uma nova versão do modelo

- Gerar respostas em tempo real – o crawler visita o site no momento em que um utilizador faz uma pergunta, e usa o conteúdo para construir a resposta (RAG)

- Alimentar índices de pesquisa com IA – como o Perplexity ou o ChatGPT Search, que constroem os seus próprios índices de conteúdo web

São três casos de uso distintos, com implicações diferentes para a tua estratégia.

E podes controlar cada um deles de forma independente, se souberes os user-agents certos.

Os principais crawlers de IA e os seus user-agents

Aqui estão os crawlers de IA mais relevantes que podes encontrar no teu robots.txt:

| Sistema | User-agent | Empresa | Uso principal |

|---|---|---|---|

| ChatGPT / OpenAI | GPTBot |

OpenAI | Treino de modelos + ChatGPT Search |

| ChatGPT Search | OAI-SearchBot |

OpenAI | Pesquisa web em tempo real no ChatGPT |

| Claude / Anthropic | ClaudeBot |

Anthropic | Treino de modelos + pesquisa web |

| Google AI / Bard / Gemini | Google-Extended |

Treino de modelos Gemini e Bard | |

| Perplexity | PerplexityBot |

Perplexity AI | Índice de pesquisa em tempo real |

| Meta AI | Meta-ExternalAgent |

Meta | Treino de modelos Llama |

| Apple | Applebot-Extended |

Apple | Treino de modelos Apple Intelligence |

| Common Crawl | CCBot |

Common Crawl | Dataset de treino usado por múltiplos modelos |

| Cohere | cohere-ai |

Cohere | Treino de modelos empresariais |

| Amazon | Amazonbot |

Amazon | Treino de modelos Alexa e AWS |

Esta lista não é estática, novos crawlers de IA surgem regularmente.

É boa prática rever o teu robots.txt pelo menos uma vez por semestre, e verificar se há novos user-agents relevantes para a tua estratégia.

Bloquear ou permitir? A decisão estratégica

Esta é a pergunta que mais divide profissionais de marketing digital: devo bloquear os crawlers de IA ou deixá-los passar?

Não existe uma resposta única. Depende dos teus objetivos.

Aqui estão os três cenários mais comuns:

Cenário 1 – Permitir tudo (estratégia de visibilidade)

Se o teu objetivo é ser citado por sistemas de IA e aparecer nas respostas do ChatGPT, do Perplexity ou do Google AI Overview, a lógica é permissiva.

Queres que os crawlers leiam o teu conteúdo, o indexem e o usem como fonte.

Neste caso, o robots.txt para crawlers de IA não precisa de ter nada especial, a ausência de regras de bloqueio significa que tudo está permitido por defeito.

Mas podes ser explícito com permissões para reforçar o sinal.

Esta é a abordagem recomendada para a maioria dos criadores de conteúdo, consultores, profissionais de serviços e empresas que querem aumentar a sua visibilidade nos sistemas de pesquisa com IA.

É também o que o Método R.E.F.E.R.E.N.C.I.A.™ recomenda como ponto de partida.

Cenário 2 – Bloquear treino, permitir pesquisa (estratégia híbrida)

Alguns criadores de conteúdo têm uma posição específica: não querem que o seu trabalho seja usado para treinar modelos de IA (por questões de direitos de autor ou filosofia editorial), mas aceitam que os sistemas de pesquisa em tempo real citem as suas páginas.

Neste caso, a configuração é cirúrgica: bloqueias o GPTBot (que é usado para treino) mas permites o OAI-SearchBot (que é usado para pesquisa em tempo real no ChatGPT).

Da mesma forma, podes bloquear o Google-Extended sem afetar o Googlebot normal.

Cenário 3 – Bloquear tudo (estratégia de proteção)

Publicações de imprensa, editoras, sites com conteúdo premium por subscrição, e criadores com modelo de negócio baseado no conteúdo exclusivo, podem preferir bloquear todos os crawlers de IA.

O risco desta abordagem é claro: ficas invisível nos sistemas de pesquisa com IA.

Enquanto os teus concorrentes são citados pelo ChatGPT e pelo Perplexity, o teu site não aparece. É uma decisão consciente com consequências diretas na visibilidade.

Exemplos práticos de robots.txt para IA

Configuração 1 – Permitir todos os crawlers de IA (recomendado para visibilidade)

User-agent: *

Disallow:

User-agent: GPTBot

Allow: /

User-agent: OAI-SearchBot

Allow: /

User-agent: ClaudeBot

Allow: /

User-agent: Google-Extended

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: Meta-ExternalAgent

Allow: /

User-agent: Applebot-Extended

Allow: /

Sitemap: https://teusite.pt/sitemap_index.xml

Configuração 2 – Bloquear treino, permitir pesquisa em tempo real

User-agent: *

Disallow:

# Crawlers de treino — bloqueados

User-agent: GPTBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: Meta-ExternalAgent

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: cohere-ai

Disallow: /

User-agent: Amazonbot

Disallow: /

User-agent: Applebot-Extended

Disallow: /

# Crawlers de pesquisa em tempo real — permitidos

User-agent: OAI-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /

Sitemap: https://teusite.pt/sitemap_index.xml

Configuração 3 – Bloquear todos os crawlers de IA

User-agent: *

Disallow:

User-agent: GPTBot

Disallow: /

User-agent: OAI-SearchBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: PerplexityBot

Disallow: /

User-agent: Meta-ExternalAgent

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: cohere-ai

Disallow: /

User-agent: Amazonbot

Disallow: /

User-agent: Applebot-Extended

Disallow: /

Sitemap: https://teusite.pt/sitemap_index.xml

Configuração 4 – Permitir crawlers de IA mas proteger conteúdo premium

User-agent: *

Disallow:

# Conteúdo premium — bloqueado para todos

User-agent: GPTBot

Disallow: /membros/

Disallow: /downloads/

Allow: /

User-agent: ClaudeBot

Disallow: /membros/

Disallow: /downloads/

Allow: /

User-agent: PerplexityBot

Disallow: /membros/

Disallow: /downloads/

Allow: /

Sitemap: https://teusite.pt/sitemap_index.xml

Como editar o robots.txt no WordPress

No WordPress, o robots.txt pode ser gerido de três formas:

Método 1 – Rank Math SEO (recomendado)

O Rank Math tem um editor de robots.txt integrado.

Vai a Rank Math → Geral → Edit robots.txt.

Cola as regras diretamente no editor e guarda.

O Rank Math gere o ficheiro sem precisares de acesso FTP.

Método 2 – Upload direto via FTP

Se preferires controlo total, cria um ficheiro robots.txt com o conteúdo que queres e faz upload para a raiz do WordPress, a mesma pasta onde estão wp-config.php e wp-login.php.

Atenção: se o WordPress já tem um robots.txt virtual gerado pelo core, o ficheiro físico que fizeres upload tem precedência.

Método 3 – Yoast SEO

No Yoast, vai a SEO → Ferramentas → Editor de ficheiros

Edita o robots.txt diretamente no painel.

Verificar se o robots.txt está correto

Após editar, acede a https://teusite.pt/robots.txt no browser e confirma que as regras estão visíveis.

Podes também usar o Google Search Console → Inspeção de URLs → para verificar se o Googlebot tem acesso às páginas que queres.

robots.txt, llms.txt e ai.json – como os três se relacionam

Os três ficheiros trabalham em camadas diferentes e complementares:

- O robots.txt define quem pode entrar no teu site e onde.

É o porteiro – controla o acesso. - O llms.txt

define o que é mais importante dentro do teu site para um modelo de IA.

É o guia editorial – orienta a prioridade. - O ai.json

define quem és enquanto entidade.

É o cartão de identidade – ancora a tua identidade digital.

Um site bem preparado para IA tem os três configurados de forma coerente.

Não faz sentido ter um llms.txt a indicar as tuas páginas mais importantes se o robots.txt está a bloquear os crawlers que leem esse ficheiro.

E não faz sentido ter um ai.json com a tua identidade se os modelos não têm permissão para aceder ao teu conteúdo.

A coerência entre os três é o que faz a diferença no índice IPD-IA e é exatamente o que o pilar de Estrutura Técnica do Método R.E.F.E.R.E.N.C.I.A.™ cobre em detalhe.

Perguntas frequentes sobre robots.txt para crawlers de IA

Se bloquear o GPTBot, o meu site deixa de aparecer no ChatGPT?

Bloquear o GPTBot impede que o teu conteúdo seja usado para treinar futuras versões dos modelos da OpenAI. Mas o ChatGPT Search usa o OAI-SearchBot – um crawler diferente. Se bloqueares o GPTBot mas deixares o OAI-SearchBot livre, o teu site pode continuar a ser citado nas pesquisas em tempo real do ChatGPT, mesmo não entrando nos dados de treino.

Bloquear o Google-Extended afeta o meu ranking no Google?

Não diretamente. O Google-Extended é um crawler específico para os sistemas generativos do Google (Gemini, AI Overview). O Googlebot clássico – que define o teu ranking na pesquisa orgânica – é um agente diferente e não é afetado. Podes bloquear o Google-Extended sem nenhum impacto no teu SEO tradicional.

O robots.txt para IA é obrigatório?

Não. Se não tiveres nenhuma regra específica para crawlers de IA, o comportamento padrão é que tudo está permitido, o que, para a maioria dos sites com objetivo de visibilidade, é a configuração ideal. O robots.txt para IA só é obrigatório se quiseres bloquear ou restringir o acesso de forma explícita.

Como sei se os crawlers de IA já visitaram o meu site?

Através dos logs do servidor. No cPanel ou Plesk, acede aos access logs e procura pelos user-agents listados neste artigo (GPTBot, ClaudeBot, PerplexityBot, etc.). Ferramentas como o Cloudflare também mostram tráfego por bot nas suas analytics. A maioria dos sites com conteúdo público já recebe visitas regulares de pelo menos dois ou três destes crawlers.

Posso bloquear crawlers de IA só em algumas páginas?

Sim. A sintaxe do robots.txt permite que combines Allow e Disallow por user-agent com caminhos específicos. Por exemplo, podes bloquear o GPTBot na pasta /downloads/ mas permitir o acesso ao resto do site. A Configuração 4 neste artigo mostra exactamente como fazer isso.

O robots.txt é suficiente para proteger o meu conteúdo de ser usado por IA?

Para crawlers bem-comportados como os da OpenAI, Google, Anthropic e Meta – sim, respeitam o robots.txt. Mas crawlers de terceiros que façam scraping genérico podem ignorá-lo. Se a proteção de conteúdo é crítica para o teu modelo de negócio, o robots.txt é necessário mas não suficiente – precisas de outras camadas de proteção como autenticação ou paywalls.

Resumo – o que fazer agora

- Acede ao teu robots.txt em

teusite.pt/robots.txte vê o que está lá - Decide a tua estratégia: visibilidade total, híbrida ou proteção

- Escolhe a configuração correspondente neste artigo

- Edita o robots.txt via Rank Math, Yoast ou FTP

- Verifica o resultado acessendo

teusite.pt/robots.txtnovamente - Garante que a configuração é coerente com o teu llms.txt e ai.json

Esta configuração é uma das primeiras verificações da auditoria IPD-IA, e um dos sinais técnicos mais fáceis de corrigir com impacto imediato na preparação do teu site para sistemas de inteligência artificial.